“Hộp Đen” AI Chứng Khoán: Tính Giải Thích (XAI) Quan Trọng Thế Nào?

Trong kỷ nguyên số, Trí tuệ Nhân tạo (AI) đã trở thành “trợ thủ” đắc lực, thực hiện các giao dịch, phân tích rủi ro và dự báo xu hướng thị trường chứng khoán. Tuy nhiên, khi các mô hình AI ngày càng phức tạp (như mạng nơ-ron sâu – Deep Learning), chúng vô tình tạo ra một vấn đề lớn: “Hộp Đen” AI. Mô hình đưa ra quyết định mua/bán với độ chính xác cao, nhưng không thể giải thích tại sao nó lại làm vậy. Đây chính là lúc khái niệm “Hộp Đen” AI trong Chứng khoán: Nhà Đầu tư cần biết gì về tính Giải thích (Explainability)? trở nên cực kỳ quan trọng, quyết định đến lòng tin, sự tuân thủ pháp lý và quản trị rủi ro của nhà đầu tư.

Tính Giải thích (Explainability – XAI) không chỉ là một thuật ngữ học thuật mà là cầu nối giúp nhà đầu tư tin tưởng và sử dụng AI một cách có trách nhiệm.

I. Hiểu rõ Thách thức “Hộp Đen” AI trong Đầu tư

“Hộp Đen” (Black Box) là thuật ngữ dùng để chỉ các mô hình AI phức tạp, nơi dữ liệu đầu vào và kết quả đầu ra được xác định rõ ràng, nhưng quá trình xử lý, tính toán bên trong để đi đến kết quả lại gần như không thể hiểu được đối với con người.

Có thể bạn quan tâm Công cụ hỗ trợ giao dịch hợp đồng tương lai chỉ số VN30

1. Tại sao AI Chứng khoán dễ thành “Hộp Đen”?

- Tính Phức tạp của Dữ liệu: Thị trường chứng khoán bị chi phối bởi hàng nghìn yếu tố (kinh tế vĩ mô, báo cáo tài chính, tâm lý đám đông, kỹ thuật giao dịch). Các mô hình học sâu (Deep Learning) cần xử lý khối lượng dữ liệu khổng lồ này, tạo ra hàng tỷ mối quan hệ phi tuyến tính mà con người không thể truy vết.

- Ưu tiên Hiệu suất hơn Minh bạch: Trong tài chính, các quỹ đầu tư và hệ thống giao dịch thường ưu tiên mô hình có độ chính xác dự đoán cao nhất, bất kể mô hình đó có khả năng giải thích thấp hay không. Điều này vô tình củng cố vấn đề “hộp đen”.

2. Hậu quả của Quyết định “Mù quáng”

Việc chấp nhận một tín hiệu mua/bán từ “hộp đen” có thể dẫn đến rủi ro nghiêm trọng:

- Thiếu Niềm tin: Nếu mô hình ra lệnh bán tháo mà không giải thích lý do, nhà đầu tư (hoặc quản lý quỹ) khó lòng tuân thủ, dẫn đến sự can thiệp cảm tính.

- Rủi ro Thiên vị (Bias): Nếu mô hình được huấn luyện bằng dữ liệu có sẵn thiên kiến lịch sử, nó có thể đưa ra các quyết định bất công hoặc sai lầm có hệ thống (ví dụ: chỉ khuyến nghị các cổ phiếu lớn), mà không ai phát hiện ra lỗi logic đó.

- Vấn đề Pháp lý & Tuân thủ (Compliance): Trong lĩnh vực tài chính, các cơ quan quản lý (như UBCK) thường yêu cầu các tổ chức giải thích được mọi quyết định ảnh hưởng đến khách hàng hoặc thị trường. Nếu một giao dịch thuật toán gây ra biến động lớn, việc không giải thích được lý do sẽ vi phạm quy định.

II. Tính Giải thích (Explainability – XAI) là gì?

Tính Giải thích của AI (XAI) là lĩnh vực nghiên cứu nhằm phát triển các phương pháp và công cụ làm cho các quyết định của mô hình AI trở nên dễ hiểu, minh bạch và có thể kiểm chứng bởi con người. Mục tiêu là chuyển mô hình “Hộp Đen” thành “Hộp Trắng” (White Box) hoặc ít nhất là “Hộp Kính Mờ” (Translucent Box).

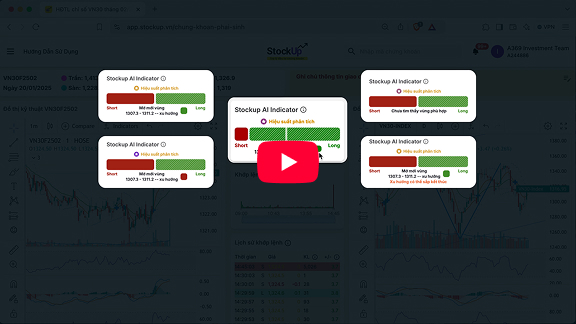

Có thể bạn quan tâm Công cụ AI Chứng Khoán

1. Các cấp độ Giải thích mà Nhà Đầu tư cần

Một lời giải thích hoàn chỉnh cho quyết định mua cổ phiếu X ở mức giá $100 phải trả lời được các câu hỏi sau:

| Câu hỏi | Ý nghĩa | Ứng dụng trong Chứng khoán |

| Tại sao (Why)? | Lý do mô hình đưa ra quyết định này. | “Vì chỉ báo RSI < 30 và Khối lượng tăng đột biến 50% so với trung bình 20 ngày.” |

| Làm thế nào (How)? | Quá trình các yếu tố được kết hợp. | “Khối lượng có trọng số gấp đôi RSI trong thuật toán ra quyết định mua.” |

| Điều gì sẽ xảy ra (What if)? | Quyết định sẽ thay đổi nếu dữ liệu đầu vào khác. | “Nếu RSI chỉ ở mức 35, tín hiệu mua sẽ không được kích hoạt.” |

| Khi nào (When)? | Mô hình có đáng tin cậy không. | “Mô hình này đã đúng 80% trong các điều kiện thị trường tương tự.” |

2. Các Công cụ XAI Phổ biến

Để gỡ bỏ rào cản “Hộp Đen” AI trong Chứng khoán: Nhà Đầu tư cần biết gì về tính Giải thích (Explainability)?, các nhà khoa học dữ liệu sử dụng các kỹ thuật như:

- LIME (Local Interpretable Model-agnostic Explanations): Giải thích quyết định của mô hình tại một điểm dữ liệu cụ thể (ví dụ: giải thích lý do mô hình quyết định mua cổ phiếu A vào ngày hôm nay).

- SHAP (SHapley Additive exPlanations): Xác định mức độ quan trọng (trọng số) của từng yếu tố đầu vào (features) đối với kết quả dự đoán của mô hình. Ví dụ: SHAP có thể chỉ ra rằng, trong quyết định mua, chỉ số P/E đóng góp 40%, còn tỷ lệ nợ/vốn chủ sở hữu đóng góp 10%.

- Sử dụng Mô hình trong suốt (Transparent Models): Ưu tiên các mô hình đơn giản hơn (như Cây Quyết định – Decision Tree) mà con người có thể tự đọc và hiểu logic, thay vì Mạng Nơ-ron sâu.

III. Vai trò của Tính Giải thích đối với Nhà Đầu tư Cá nhân

Đối với nhà đầu tư cá nhân, XAI không chỉ là công cụ quản trị rủi ro mà còn là công cụ học hỏi và xây dựng niềm tin.

1. Nâng cao Niềm tin và Kỷ luật

Khi AI đưa ra một khuyến nghị, nhà đầu tư có thể xem xét lời giải thích kèm theo để xác nhận logic. Điều này giúp:

- Tăng cường Kỷ luật: Nếu lời giải thích dựa trên các nguyên tắc phân tích cơ bản (Fundamental Analysis) hoặc phân tích kỹ thuật (Technical Analysis) vững chắc, nhà đầu tư sẽ dễ dàng tuân thủ lệnh cắt lỗ hoặc chốt lời hơn, ngay cả khi cảm xúc chi phối.

- Hạn chế Dựa dẫm Mù quáng: Nhà đầu tư hiểu rằng AI chỉ là công cụ. Họ có thể chất vấn logic của AI nếu lời giải thích mâu thuẫn với kinh nghiệm hoặc kiến thức thị trường của họ, tránh phụ thuộc hoàn toàn.

Xem thông tin Giá vàng hôm nay

2. Phân biệt Sai lầm Dữ liệu và Sai lầm Thuật toán

Tính giải thích cho phép nhà đầu tư hoặc chuyên gia kiểm tra:

- Lỗi Dữ liệu: Nếu AI đưa ra quyết định sai, XAI có thể chỉ ra rằng mô hình đã quá tập trung vào một dữ liệu nhiễu (ví dụ: một tin đồn không chính thức).

- Lỗi Thuật toán: Nếu XAI cho thấy mô hình gán trọng số quá cao cho một chỉ báo không phù hợp với chu kỳ thị trường hiện tại, nhà phát triển có thể điều chỉnh lại thuật toán.

Tóm lại, Tính Giải thích (Explainability) là một yêu cầu tất yếu trong kỷ nguyên AI. Nó không nhằm mục đích làm cho AI kém chính xác hơn mà là để làm cho nó đáng tin cậy hơn. Nhà đầu tư cần chủ động tìm hiểu và yêu cầu các nền tảng AI cung cấp khả năng giải thích rõ ràng. Một mô hình AI không có giải thích cũng giống như một lời khuyên từ một chuyên gia vô danh – rủi ro rất cao và khó kiểm soát. Bằng cách hiểu rõ XAI, nhà đầu tư sẽ có thể quản trị rủi ro tốt hơn và đưa ra quyết định đầu tư thông minh, dựa trên cơ sở khoa học và có trách nhiệm.